遏止Deepfake!性影片、政治詐騙科技犯罪難防,修法跟得上?

圖/Pexels。

圖/Pexels。 隨著AI科技的發達,近年深度偽造技術(deepfake)盛行,不只在好萊塢影視圈大量運用,更可怕的是被用在不法情事上,國內就曾發生網紅「小玉」(朱玉宸)以「AI Deepfake」技術,將立委、明星、網紅、小模等多名女性「換臉」到A片中販售牟利,造成被害人身心靈受創。為此,行政院提出修法,製作不實性影像並散布營利,最高處7年有期徒刑。

低成本製作,Deepfake惡作劇挑戰社會道德底線

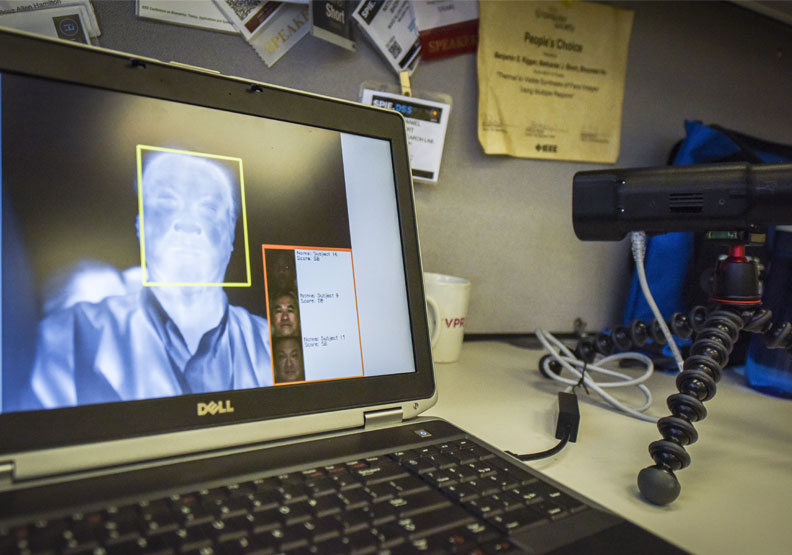

「Deepfake」一詞是由「deep learning(深度學習)」、「fake(偽造)」兩個詞彙混合而成,單就字面上就可以感受到隱含一點負面意涵。這項技術是基於AI運算的人體圖像合成技術,將現有的圖像或影片,透過運算即時模擬表情、肌肉、光影等變化,以最擬真的情境疊加到目標上。

Deepfake技術最常被運用在色情影視上,或是用來偽造名人性愛片、報復性影片等;根據研究,有高達96%的Deepfake製作內容,都是未經同意的色情內容。

台灣同樣也受到Deepfake技術濫用的衝擊。網紅「小玉」便透過該技術,偽造白癡公主、奎丁、蕾拉等網紅的情色影片販售營利,連總統蔡英文、議員黃捷、立委高嘉瑜等都難逃魔掌,不法所得高達千萬。2020年檢調偵破後震驚各界,由於國內法規跟不上科技的演變,最終檢察官諭令小玉以30萬元交保。

為了避免未來再有類似情事發生,行政院10日拍板通過刑法部分條文修正草案以及《兒童及少年性剝削防制條例》、《性侵害犯罪防治法》、《犯罪被害人保護法》等4項修法,規範若製作不實性影像並散布,最重可處5年有期徒刑;若製作且販售營利,最高則可處7年6個月有期徒刑。

法務部強調,這次的修正,針對Deepfake技術的犯罪行為進行規範並且加重刑責,目的就是要提醒民眾應有尊重他人的道德意識,不應未經同意就攝錄或散布性影像,製作造假的深度偽造技術影片更是重中之重,以便維護國人的性隱私與人格權。

政治操作、商業詐騙,Deepfake難辨真假防不勝防

除了性影像再製,Deepfake技術也被廣泛運用在商業目的上,有媒體以此技術製作傳播素材,或是保護吹哨者、舉報者身分等。愈來愈多使用面向,讓Deepfake的技術更加成熟,也讓有心人士注意到藉此牟取暴利的「商機」。

Just For You

Just For You